هواوی و قانون تائو؛ نوآوری یا اعتراف به بنبست؟

هواوی بار دیگر تلاش کرده است روایت تازهای از آینده صنعت نیمههادی ارائه کند. این…

۱۳ خرداد ۱۴۰۵

۵ اردیبهشت ۱۴۰۲

زمان مطالعه : ۵ دقیقه

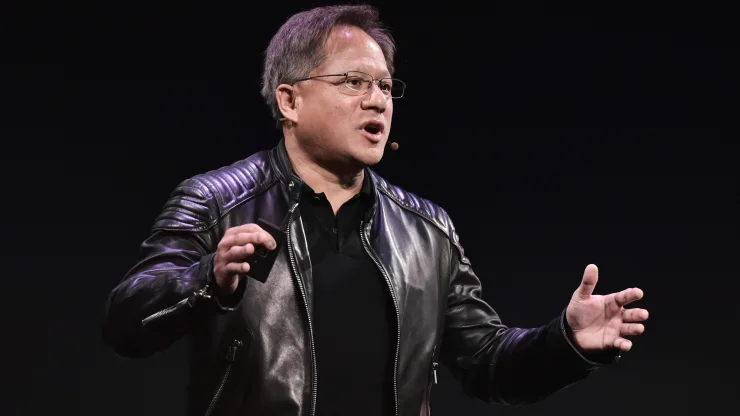

شرکت انویدیا روز سه شنبه از یک عرضه یک نرمافزار جدید برای جلوگیری از اشتباه مدلهای هوش مصنوعی خبر داد. این محصول به تولید کنندگان نرمافزار کمک میکند تا جلوی بیان حقایق اشتباه، موضوعات خطرناک یا رخنههای امنیتی در هوش مصنوعی را بگیرند.

به گزارش پیوست، اشتباهات و توهم هوش مصنوعی یکی از مشکلات اصلی این صنعت محسوب میشود به طوری که تنها یک اشتباه چتبات بارد (Bard) از گوگل به ریزش ۱۰۰ میلیارد دلاری سهام این شرکت منجر شد. در اینجا منظور از توهم حالتی است که مدل هوش مصنوعی یک اشتباه را با حقیقتی مستند اشتباه گرفته و آن را در پاسخ به سوالی ارائه میکند.

علاوه بر این موضوع شایعهپراکنی، انتشار اطلاعات وارونه و دور زدن محدودیتهایی که برای جلوگیری از سو استفاده کاربران طراحی شده نیز موضوع مهمی برای شرکتهای بزرگ حال حاضر به حساب میآید.

براساس گزارشی که CNBC منتشر کرده است، شرکت انویدیا برای رفع این مشکل نرمافزاری به نام NeMo Guardrails را در اختیار تولیدکنندگان هوش مصنوعی قرار میدهد. مساله «توهم» هوش مصنوعی یکی از معضلات اصلی مدلهای زبانی عظیم است که مانعی بر سر راه فراگیر شدن این ابزار به حساب میآید.

مدلهای زبانی عظیم از جمله GPT از اوپنایآی (OpenAI)، شرکت تحت حمایت مایکروسافت، و LaMDA از گوگل، با استفاده از حجم زیادی اطلاعات آموزش دیدهاند و با شبیهسازی انسان متونی مانند ما را تولید و در اختیار کاربران میگذارند. اما یک معضل بزرگ تمایل این مدلها به «توهم» یا خلق حقیقتی غیرواقعی است. برای اینکه بتوان از این مدلها در زمینههایی مثل خلاصهسازی یا پاسخ به سوالات استفاده کرد باید عنصر توهم را حذف یا به حداقل رساند.

نرمافزار ساخته انویدیا با در نظر گرفتن یک سری محدودیتها کاری میکند تا نرمافزار به سراغ یک سری مباحث نرود. NeMo Guardrails همچنین میتواند یک چتبات LLM را مجبور کند تا در مورد یک موضوع مشخص صحبت کرده، محتوای سمی را کنار بزند و از اجرای دستورهای خطرناک در کامپیوتر خودداری کند.

جانتان کوهن، ناسیب رئیس بخش تحقیقات انویدیا میگوید: «میتوانید اسکریپتی بنویسید که بگوید اگر شخصی درمورد این موضوع صحبت کرد در هرصورت این جواب را به او ارائه کن. دیگر نیاز نیست در پیروی از دستور یا مقررات به یک مدل زبانی اعتماد کنید. آنچه اتفاق میافتاد به سختی در منطق اجرایی سیستم محافظتی جای میگیرد.»

این بیانیه همچنین بر استراتژی شرکت انویدیا برای پیشتازی در صنعت چیپهای هیش مصنوع در کنار توسعه نرمافزارهای مهم یادگیری ماشینی نیز تاکید دارد.

پردازندههای گرافیکی شرکت انویدیا یکی از محصولات اصلی مورد نیاز برای آموزش و استفاده از نرمافزاری مثل ChatGPT هستند. طبق گفته تحلیلگران شرکت انویدیا بیش از ۹۵ درصد از بازار چیپهای هوش مصنوعی را به خود اختصاص داده است اما رقابت در این حوزه در حال افزایش است.

NeMo Guardrails لایهای نرمافزاری است که بین کاربر و مدل زبانی عظیم یا دیگر ابزارهای هوش مصنوعی قرار میگیرد. این لایه خروجیهای و دستورهای نادرست را پیش از ارائه به کاربر فیلتر میکند.

به گفته انویدیا این نرمافزار را برای مثال میتوان در چتباتهای خدمات مشتریان استفاده کرد. توسعه دهندگان میتوانند نرمافزار ساخت این شرکت را به گونهای تنظیم کنند تا چتبات از حاشیه رفتن و پرداختن به موضوعات جانبی اجتناب کرده و درنتیجه خدمات بهتری را در اختیار کاربران قرار دهد.

کوهن میگوید: «اگر یک چتبات خدمات مشتریان برای صحبت درمورد محصولات طراحی شده باشد، شما نمیخواهید که به سوالاتی درمورد رقبا پاسخ دهد. دوست دارید که روی مکالمه نظارت کنید و اگر چنین اتفاقی افتاد بحث را به مسیر اصلی خود برگردانید.»

انویدیا در معرفی این محصول مثالی از چتباتی را ارائه کرده است که به سوالات منابع انسانی داخلی شرکت جواب میدهد. در این مثال انویدیا توانست با در نظر گرفتن محدودیتهایی این چتبات مبتنی بر ChatGTP را به گونهای قانونمند سازد که به سوالاتی درمورد عملکرد مالی شرکت پاسخ نداده و یا به دادههای خصوصی کاربران دسترسی پیدا نکند.

این نرمافزار میتواند توهم مدلهای زبانی عظیم را نیز شناسایی کنید. در این روش نرمافزار انویدیا برای حقیقتسنجی اطلاعات یک مدل زبانی عظیم، از پاسخهای مدل زبانی دیگری استفاده میکند و در نهایت اگر پاسخ هردو مدل زبانی یکسان نباشد، پاسخ نهایی «نمیدانم» است و اطلاعات نادرست به کاربر نهایی منتقل نمیشود.

انویدیا روز دوشنبه اعلام کرد که این نرمافزار در مباحث امنیتی نیز کاربرد داشته و مدلهای زبانی عظیم را مجبور میکند تا تنها براساس یک لیست مجاز با نرمافزار شخص ثالث ارتباط بگیرند.

NeMo Guardrails متن باز است و از طریق خدمات انویدیا ارائه میشود. این نرمافزار را میتوان برای کاربردهای تجاری نیز استفاده کرد. برنامهنویسان برای تعیین مقررات دلخواه خود میتوانند از بان گولنگ (Golang) استفاده کنند.

شرکتهای هوش مصنوعی دیگری از جمله گوگل و اوپنایآی برای محدود کردن پاسخهای خطرناک در مدلهای زبانی خود از روشی به نام یادگیری مجدد براساس بازخورد انسانی استفاده میکنند. در این روش که با حضور انسان انجام میشود، افرادی دادههای صحیح برای یک سوال را مشخص کرده و سپس مدل هوش مصنوعی را با استفاده از آن آموزش میدهند.

انویدیا که پیشتر به عنوان یکی از فروشندگان مهم سختافزار اسختراج رمزارز شناخته میشد راه خود را از این صنعت جدا کرده و به تازگی با انتقاد از صنعت رمزارز، تمرکز خود را معطوف هوش مصنوعی کرده است، صنعتی که قلب تپنده سختافزاری آن تقریبا در انحصار همین شرکت آمریکایی است و NeMo Guardrails ممکن است به پیشتازی نرمافزار انویدیا نیز کمک کند.