مسیر کابلهای هرمز و اینترنتی که نقشه خودش را ندارد

اینترنت معمولاً شبکهای بیمرز و ابری تصور میشود، اما بخش اصلی ارتباطات بینالمللی هنوز از…

۳ خرداد ۱۴۰۵

۲۲ تیر ۱۴۰۳

زمان مطالعه : ۸ دقیقه

استفاده از هوش مصنوعی مولد در ساختار کاری توسط شرکتها و سازمانها بهعلاوه قابلیتها و چالشها نیازمند اتخاذ روشهایی برای استفاده مسئولانه از این فناوری است. یک رویکرد جامع و مسئولانه به هوش مصنوعی به شرکتهای پیشرو کمک میکند تا سریعتر به ارزشی که از این فناوری کسب میکنند دست یابند و کارایی تقویت شود.

به گزارش پیوست، برای هر شرکتی امکان توسعه این نوع رویکرد مسئولانه وجود دارد. فعال و پیادهسازی رویکرد مسئولانه استفاده از هوش مصنوعی شامل سه مولفه آرزوها و تعهدات، فرآیندهای حکمرانی و نقشها و فرهنگ است.

هوش مصنوعی مولد هم شور و شوق ناشی از بدعت را به همراه دارد هم نگرانیهای قابل توجهی را به وجود آورده است. در حالی که ذینفعان جهت بهکارگیری این فناوری و بهرهمندی از قابلیتهای آن برای پیشرفت و ایجاد تمایز هیجانزده هستند اما سوالات مربوط به اخلاق، تعصب، حریم خصوصی دادهها، نگرانی شغلی و مقرراتگذاری به قوت خود باقی است.

این مسائل و نگرانیها برای شرکتها تنها با یک رویکرد جامع به مسئولیت هوش مصنوعی قابل رسیدگی است بلکه این رویکرد باید شامل اقدامات سازمانی مانند تعیین نقشها و مسئولیتهای مناسب و همچنین اقدامات فناورانه برای آزمایش و نظارت مدل باشد.

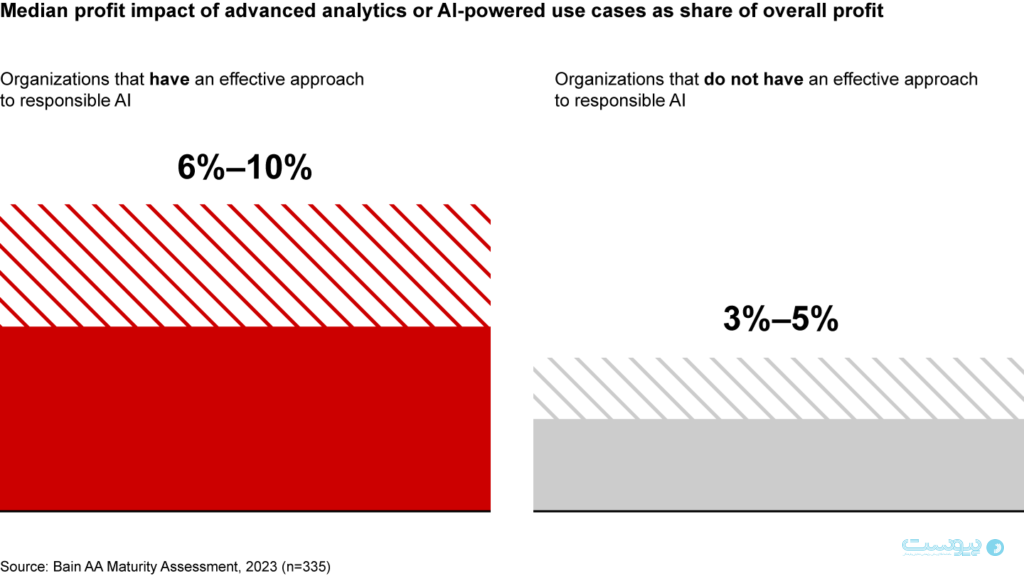

با توجه به تجربههای گوناگون، شرکتهایی که رویکرد جامع و مسئولانه به هوش مصنوعی دارند، ۲ برابر بیشتر از هوش مصنوعی سود میبرند.

مدیرانی که این رویکرد را دارند و در استفاده از نوآوریها پیشتازند چندان محتاط نیستند. این دسته از مدیران از خطرات احتمالی استفاده و بهکارگیری از نوآوری تکنولوژیکی نمیترسند. آنها به سرعت موارد استفاده را پیادهسازی و برنامههای کاربردی پیچیده را اجرا میکنند. آنها از ارزشی که هوش مصنوعی خلق میکند برای تسریع و تقویت کارها استفاده میکنند. این افراد فقط روی جنبههای قابل استفاده هوش مصنوعی تمرکز ندارند و رویکرد آنها شامل شناسایی مواردی هم میشود که برای آنها کاربردی ندارد. اهمیت و کارایی نداشتن یک مورد از فناوری در طرح کلی و برنامههای این سبک از مدیریت در واقع احتمالی دانستن وضعیت آن فناوری است. ممکن است فناوریای که اکنون برای یک مجموعه ارزشمند و کارا نباشد پس از مدتی موثر واقع شود.

برای هر شرکتی امکان توسعه این نوع رویکرد مسئولانه وجود دارد. فناوریهای هوش مصنوعی مولد جدید هستند اما یادگیری ماشین و خود هوش مصنوعی موضوع جدیدی نیست.

این سیاستها شیوههای خوبی را برای توسعه مدلهای قوی، مستند و معتبر و اجرای چالشها و رویههای نظارتی موثر تقویت کرد. در طول دهه ۲۰۱۰، شرکتهای فناوری پیشرو مانند Google روشهای آزمایش و عملیات یادگیری ماشین را تکامل دادند که اطمینان بیشتری از امنیت، دقت و پایداری سیستمهای یادگیری ماشین ایجاد کرد.

فراتر از خطرات طولانی مدت مانند سوگیری، توضیحپذیری و استفاده مخرب، هوش مصنوعی مولد خطرات دیگری از جمله توهم، نامشخص بودن منشأ دادههای آموزشی و مالکیت خروجی را به همراه دارد. با تکیه بر تجارب خدمات مالی و صنایع فناوری، سازمانها باید به ۶ تعهد برای مدیریت ریسکهای سیستم هوش مصنوعی پایبند باشند.

یک رویکرد جامع برای هوش مصنوعی مسئول دارای سه جزء است.

۱- آرزوها و تعهدات: شرکتها باید به وضوح به ذینفعان و همکاران توضیح دهند که چگونه میخواهند خطرات ناشی از فناوریهای جدید را مدیریت کنند. این کار با پذیرش چالشهای جدید و پیشرفته آغاز میشود که این چالشها نه تنها شامل ابعاد فناوری است بلکه نگرانیهای مربوط به برابری و اجتماعی را نیز در بر دارد و نیاز به توجه، پیگیری و ارتباطات فعال را ایجاد میکند.

۲- فرآیندهای حکمرانی، نقشها و فناوری: شرکتها باید رویکردهای موجود را با فناوریها و شیوههای جدیدی که به چرخه حیات سیستمهای منحصربهفرد راهحلهای هوش مصنوعی میپردازد تقویت کنند. برای مثال شیوههای حاکمیت و مدیریت دادهها باید چالشهای امنیتی، حریم خصوصی و مالکیت جدیدی را پوشش دهد. نقشها، مسئولیتها، انجمنها و شوراها همگی نیاز به بازنگری و گسترش خواهند داشت تا بهطور موثر بر این سیستمهای جدید و نحوه استفاده از آنها نظارت شود. این میتواند شامل انتصاب یک کارشناس ارشد اخلاق هوش مصنوعی و تشکیل یک شورای اخلاق هوش مصنوعی باشد.

۳- فرهنگ: با توجه به تاثیرات گسترده، سرعت قابل توجه پیشرفت و پذیرش فناوریهای هوش مصنوعی مولد، آموزش و مشارکت در سطح سازمان که استفاده از آنها را پوشش دهد و همچنین آرزوها و تعهدات سازمانی که به فرآیند همکاری با لحاظ این موارد شکل و نظم دهد مورد نیاز خواهد بود. با اطمینان از تکراری بودن این تلاشها، یک شرکت میتواند فرهنگ هوشیاری و یادگیری را پرورش دهد که به طور مداوم توانایی خود را برای استفاده مسئولانه از هوش مصنوعی بهبود بخشد.

تمام افراد درگیر با یک سازمان از جمله مشتریان، کارمندان، سهامداران، سرمایهگذاران، قانونگذاران و جامعه، علاقهمندند که سازمانها به شکل مسئولانهای به دنبال راهحلهای هوش مصنوعی بروند.

این گروهها انتظار دارند شرکتها در امنیت، دقت و بیطرفی سیستمهایشان سرمایهگذاری کنند. همچنین آنها میخواهند که این سیستمها به طور اخلاقی به کار گرفته شود و با در نظر گرفتن قوانین و الزامات آتی طراحی و انطباق داده شود.

البته هر سازمانی تعهدات خود را با قابلیتها، مواجهههای بالقوه، الزامات خاص بازار و موقعیت خود تنظیم میکند. استراتژی و تحمل ریسک تعیین میکند که یک شرکت از کدام هوش مصنوعی استفاده کند و به نوبه خود سرمایهگذاری مورد نیاز و میزان ارزشی را که میتوان انتظار داشت تولید کند. به عنوان مثال برخی از سازمانها در صنایع تحت نظارت تا زمانی که این فناوری را بهتر درک کنند از به کار بردن برنامههای مستقیم مبتنی بر مشتری از هوش مصنوعی مولد خودداری کردهاند.

پس از اینکه شرکتها تعهدات خود را بیان کردند، در حالی که به دنبال فرصتهایی برای استقرار محصولات و راهحلهای مبتنی بر هوش مصنوعی هستند، باید مطمئن شوند که ساختارها، سیاستها و فناوری مناسب وجود دارد.

تاثیر هوش مصنوعی مسئولانه (RAI) کل بخشهای کسبوکار و وظایف شرکتی را در بر میگیرد. به خاطر همین گستردگی، ایجاد یک نظام مدیریت بینبخشی که شامل ذینفعان کلیدی از گروههای مرتبط باشد حائز اهمیت است. نقشها و مسئولیتها باید برای همه تبیین و درک شود و رهبران کسبوکار باید در قبال ادغام RAI در محصولات و عملیاتشان پاسخگو باشند. این کار به ایجاد حس مالکیت در کل سازمان کمک میکند اما شرکتها همچنان ممکن است بخواهند برای اطمینان از پاسخگویی شفاف در قبال نتایج، یک رهبر کل سازمانی برای هوش مصنوعی مسئولانه تعیین کنند.

به عنوان مثال، شرکت مایکروسافت به تناسب این شرایط یک موقعیت شغلی جدیدی تحت عنوان «افسر ارشد مسئول هوش مصنوعی» در مجموعه ایجاد کرده است. شخصی که به این سمت منتصب میشود وظیفه دارد رویکرد شرکت را تعریف و کارمندان را برای تبدیل شدن به قهرمانان فعال هوش مصنوعی مسئول، توانمند کند. این مدیر اجرایی با «Aether» کمیته هوش مصنوعی و اخلاق داخلی مایکروسافت که تحقیقات انجام داده و توصیههایی را در مورد مسائل مهم هوش مصنوعی مسئول ارائه میدهد، همکاری میکند.

بیشتر سازمانها همچنین باید مکانیسمهای حاکمیتی موجود خود را بررسی کنند. از جمله مکانیسمهای مربوط به فناوری، دادهها، فروشندگان و امنیت اطلاعات است. آنها باید هر گونه تغییر لازم برای مقابله با خطرات جدید و تقویتشده هوش مصنوعی را شناسایی کنند.

دستورالعملها و رویهها: تدوین سیاستها و فرآیندهای درست چه جدید و چه بهروزرسانیشده باشد به نهادینهسازی انتظارات و خطمشیهای مسئولانه هوش مصنوعی در تمام سطوح سازمان کمک میکند. با تدوین سیاستها و رویههای سازمانی مانند تدوین کدهای اخلاقی برای سرویسهایی مثل چتجیپیتی سازمانی و الزامات مربوط به تامینکنندگان مدلهای پایه، میتوان در راستای استقرار و استفاده مسئولانه از این فناوریها گامی برداشت.

پلتفرمها و چارچوبهای فناوری سیستمهای هوش مصنوعی مدرن بیش از حد پیچیده و پویا هستند و نمیشود تنها از طریق تلاشهای دستی اداره شود. پلتفرمهای موثر فناوری هوش مصنوعی و چارچوبهای توسعه برنامه کاربردی برای ایجاد و امکان توسعه و استقرار سریع فناوری هوش مصنوعی و در عین حال تعبیه کنترلهای مورد نیاز برای انجام تعهدات هوش مصنوعی ضروری است.

یک پلتفرم هوش مصنوعی شامل اجزا و خدمات قابل استفاده مجدد و مقیاسپذیر با لایههای محافظ داخلی است که این امکان را برای شرکتها فراهم میکند تا سیستمهای هوش مصنوعی را به صورت ایمن و سریع مستقر کند. چارچوبهای توسعه برنامهها، پذیرش بهترین شیوهها را تسریع میکند و توسعهدهندگان سیستم هوش مصنوعی را قادر میسازد تا از رویکردهای استانداردشده برای اتوماسیون، آزمایش، ارزیابی و نظارت در سراسر چرخه عمر سیستم هوش مصنوعی استفاده کنند. این قواعد همچنین تعمیر و نگهداری طولانی مدت سیستم را تسهیل میکند و عملکرد سیستمهای هوش مصنوعی را بهطرز متمرکزی قابل مشاهده میکند و این اطمینان را افزایش میدهد که شرکت به تعهدات هوش مصنوعی مسئول خود عمل میکند.

کارکرد مثبت و نتیجهبخش بودن به کارگیری هوش مصنوعی مستلزم گنجاندن «مسئولیتپذیری» در فرهنگ سازمان است.

برخی از نشانههای شکلگیری فرهنگ هوش مصنوعی مسئول از این قرار است:

بهطور کلی بررسی، شناسایی، پیمایش و تطبیق موارد برای همگامی مسئولانه با هوش مصنوعی کار سادهای نیست اما با طی کردن این مراحل و بهکارگیری حداکثر روشها و سیاستهای نوین در این زمینه، همه اشخاص درگیر با یک سازمان بیشترین بهره را از این فناوری خواهند برد.

منبع: bain