گزارش سهماهه تنسنت؛ رشد درآمد ادامه دارد، اما آهستهتر

تنسنت در گزارش مالی سهماهه نخست ۲۰۲۶ اگرچه از رشد درآمد و بازدهی سرمایهگذاریهای هوش…

۲۳ اردیبهشت ۱۴۰۵

۱۵ آبان ۱۴۰۳

زمان مطالعه : ۳ دقیقه

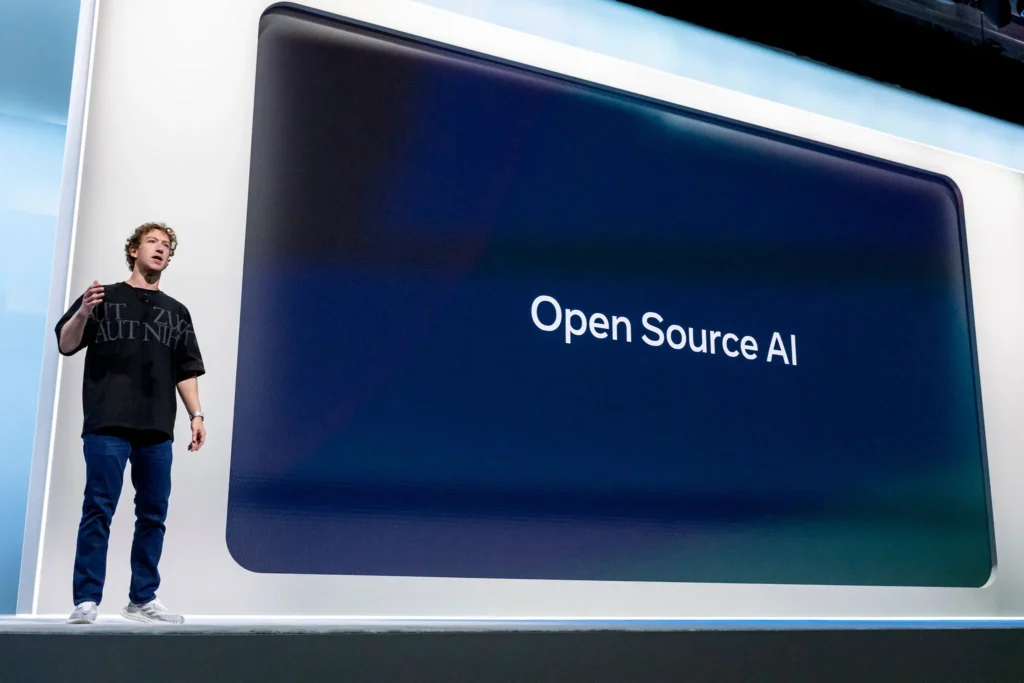

متا روز دوشنبه اعلام کرد که آژانسهای دولتی آمریکا و پیمانکاران حوزه امنیت ملی میتوانند از مدلهای هوش مصنوعی این شرکت برای اهداف نظامی استفاده کنند. این بیانیه تغییر رویکرد بزرگی نسبت به منع پیشین متا برای استفاده نظامی از فناوریهای این شرکت محسوب میشود.

به گزارش پیوست به نقل از نیویورک تایمز، متا میگوید مدلهای هوش مصنوعی خود به نام Llama را در اختیار آژانسهای فدرال آمریکا میگذارد و با پیمانکاران دفاعی از جمله Lockheed Martin و Booz Allent و پیمانکاران متمرکز بر فناوری از جمله Palantir و Anduril همکاری میکند. مدلهای Llama «متن باز» هستند که به معنی دسترسی و توزیع آزاد آنها توسط توسعه دهندگان، شرکتها و دولتها است.

اقدام جدید متا یک استثنا نسبت به «سیاست کاربرد قابل قبول» این شرکت محسوب میشود که استفاده از نرمافزار هوش مصنوعی متا را برای «صنایع هستهای و نظامی» ممنوع میکند.

نیک کلگ، رئیس امور بینالملل متا، روز دوشنبه در یک پست وبلاگی گفت که این شرکت از «کاربرهای مسئولانه و اخلاقی» این فناوری که از ایالات متحده و «ارزشهای دموکراتیک» در رقابت جهانی هوش مصنوعی حمایت میکند، پشیتبانی خواهد کرد.

کلگ نوشت: «متا میخواهد نقش خود را در حمایت از امنیت، ایمنی و رونق آمریکا- و نزدیکترین متحدانش-ایفا کند.» او افزود که «استفاده گسترده از مدلهای هوش مصنوعی آمریکایی برای منافع اقتصادی و امنیتی مفید است.»

سخنگوی متا می؛وید این شرکت فناوری خود را با اعضای اتحادی اطلاعاتی پنچ چشم، شامل کانادا، بریتانیا، استرالیا، نیوزیلند و آمریکا به اشتراک میگذارد. بلومبرگ نیز پیش از این در گزارشی به اشتراکگذاری فناوری متا با کشورهای پنج چشم اشاره کرده بود.

متا، مالک فیسبوک، اینستاگرام و واتساپ فعالیت چشمگیری در گسترش استفاده از هوش مصنوعی دارد. رقبایی مثل اوپنایآی، مایکروسافت، گوگل و آنتروپیک به دنبال پیشتازی در عصر هوش مصنوعی هستند اما متا که تا حدی از این رقبا عقب مانده با رویکرد متنباز برای جبران اختلاف تلاش میکند. براساس آخرین آمار ماه آگوست، نرمافزار این شرکت بیش از ۳۵۰ میلیون مرتبه دانلود شده است.

البته که متا با انتقاداتی نسبت به اقدام جدید خود روبرو است. فناوریهای و اپلیکیشنهای نظامی سیلیکونولی در سالهای اخیر بحثبرانگیز شدهاند و کارکنان شرکتهایی مثل مایکروسافت، گوگل و آمازون به شدت علیه قرارداد نظامی با آژانسهای دفاعی و ارتش اعتراض کردهاند.

متا همچنین به دلیل رویکرد متن باز خود نیز هدف انتقاداتی قرار گرفته است. گوگل و اوپنایآی میگویند هسته اصلی هوش مصنوعی و فناوری آنها به حدی پتانسیل سو استفاده دارد که عرضه آن منطقی و امن نیست اما متا میگوید هوش مصنوعی را تنها در صورتی میتوان به صورت امن توسعه داد که میلیونها نفر کد آن را دیده و ارزیابی کنند.

به گفته افراد مطلع، مدیران متا همچنین نگران قانونگذاری شدید دولت آمریکا و دیگر دولتها علیه هوش مصنوعی متن باز هستند. گزارش اخیر رویترز درمورد استفاده موسسات تحقیقاتی مرتبط با دولت چین از Llama برای ساخت اپلیکیشنهایی برای ارتش آزادیبخش خلق چین نیز انتقادات را افزایش داده است. مدیران متا البته با انتقاد از این گزارش اعلام کردهاند که دولت چین اجازه استفاده از Llama برای اهداف نظامی را ندارد.

کلگ در پست روز دوشنبه خود گفت دولت آمریکا میتواند از این فناوری برای ردیابی فعالیتهای تروریستی و بهبود امنیت سایبری موسسات آمریکایی استفاده کند. او چندین مرتبه تکرار کرد که مدلهای هوش مصنوعی متا به پیشتازی ایالات متحده از دیگر دولتها کمک می:ند.

او گفت: «هدف ما باید ساخت یک حلقه شریقه باشد که به ایالات متحده در حفظ برتری فناورانه و همچنین گسترش بینالمللی هوش مصنوعی و تضمین مسئولیتپذیری و اخلاقی بودن نوآوریها و حمایت از منافع استراتژیک و ژئوپلیتیک ایالات متحده و متحدان نزدیک آن کمک کند.»