چراغ نیمسوز موتور جریان دانش هوش مصنوعی در ایران

در دنیای امروز، دیگر تولید علم بهتنهایی معیار پیشرفت نیست؛ بلکه آنچه سرنوشت یک فناوری…

۱۸ خرداد ۱۴۰۵

۱۵ بهمن ۱۳۹۹

زمان مطالعه : ۱۴ دقیقه

فیسبوک مدتها پیش، حتی کمی قبل از انتخابات 2016 هدف انتقاد بسیاری درمورد نحوه مدیریت پلتفرم و سیاستهای داخلی خود قرار گرفتهاست. منتقدان معتقد هستند که این شبکه اجتماعی به مکان مناسبی برای انتشار شایعات و نفرت پراکنی تبدیل شده است. با این حال برخی دیگر هم اقدامات فیسبوک و دیگر پلتفرمها در جهت مقابله با نفرت پراکنی را نقض آزادی بیان و تنها پاک کردن صورت مسئله میدانند.

به گزارش پیوست، این غول تکنولوژی نتوانست بین الگوی آزادی بیان مارک زاکربرگ و حزبگرایی در یکی از قابلیتهای اصلی خود تعادل ایجاد کند. فیسبوک در سال ۲۰۱۹ پرچمدار خود را بازطراحی کرد تا تمرکز خود را روی گروهها و فرومها برای کاربران مشابه قرار دهد، در آن زمان مارکز زاکربرگ مدیرعامل این شرکت این ویژگی جدید را «قلب اپلیکیشن» نامید. حال این قابلیت تبدیل به پاشنه آشیل برای این پلتفرم شده است.

حالا این غول شبکه اجتماعی روی اصلاح گروهها متمرکز شده است. این تلاش زمانی آغاز شد که تحقیقات فیسبوک نشان داد گروههای این شبکه اجتماعی به مکانی برای رشد حزبگرایی و حتی درخواست برای خشونتی تبدیل شده است که پس از انتخابات کشور را تحت تاثیر قرار داد.

تغییراتی که فیسبوک پس از ناآرامیهای پایتخت آمریکا در 6 ژانویه انجام داد شامل اصلاح مکانیک محصولی است که قرار بود عنصر اصلی این اپلیکیشن باشد.

مجریان فیسبوک سالها پیش مطلع بودند ابزارهایی که به رشد سریع گروهها کمک میکند مانعی برای ساخت جوامع سالم آنلاین محسوب میشود و این شرکت نتوانست این ابزارها را کنترل کند.

براساس مستنداتی که روزنامه والاستریت بررسی کرده، محققان داده این شرکت در ماه آگوست به فیسبوک هشدار دادند که شایعات و درخواست برای خشونت در اکثریت گروههای مهم «مدنی» دیده میشود. این گروهها عمدتا به سیاست و موضوعات این چنین مربوط بودند و روی هم رفته صدها میلیون عضو داشتند.

این محققان به مسئولان فیسبوک اطلاع دادند که یک گروه با ۵۸ هزار نفر عضو «هرروز شاهد درخواست برای خشونت» است. گروه دیگری که مدعی بود به طرفداران ترامپ اختصاص دارد در واقع از سوی «آلبانیهایی با انگیزه اقتصادی» رهبری میشد که روزانه میلیونها دیدگاه برای استوریهای جعلی خبری و محتوای محرک دریافت می کردند.

در این تحقیقات نتیجه گیری شد که تقریبا ۷۰ درصد از ۱۰۰ گروه فعال مدنی در آمریکا به دلیل نفرت پراکنی، شایعات، زورگویی و آزار و اذیت غیرقابل پیشنهاد هستند. محققان اعلام کردند که «ما باید برای توقف این مکالمهها و رشد آنها کاری انجام دهیم» و عقیده داشتند که برای کاهش سرعت رشد گروهها حداقل تا زمانی که کارکنان فیسبوک بتوانند به نقض سیاستها پاسخ دهند کاری انجام دهیم.

آنها نوشته بودند «سیستمهای یکپارچگی فعلی این مشکلات را حل نمی کنند.»

به گفته افراد مطلع و براساس مستندات موجود، فیسبوک در پاسخ به این مشکلات پیش از انتخابات برخی از معروفترین گروههای این چنین را حذف کرد و برای کاهش رشد دیگر گروهها اقدام کرد. با این حال فیسبوک این محدودیتها را موقت برشمرد و برخی از اقداماتی که محققان خود این شرکت پیشنهاد کرده بودند را انجام نداد.

در هفته های پس از انتخابات گروههای بزرگی نتایج انتخابات را به چالش کشیدند، اعتراض درمورد نتایج را ساماندهی کردند و به اعتراضات پیش از نا آرامیهای ۶ ژانویه کمک کردند. پس از ماجرای پایتخت آمریکا، فیسبوک تعداد بیشتری از این گروهها را حذف کرد و برای پاسخ به شرایط اضطراری قوانین تازهای را اتخاذ کرد.

گای روزن نماینده ارشد بخش یکپارچگی فیسبوک که بر امنیت کاربران و مسیر پلتفرم نظارت دارد میگوید این شرکت برنامههای خود برای ادامه پیشنهاد گروههای مدنی یا سلامتی را متوقف کرد. به گفته روزن فیسبوک همچنین یک سری ابزارهایی که به نظر محققان باعث رشد سریع گروههای تندرو شده بود را غیرفعال کرد و از مدیران خواست زمان بیشتری را به بررسی محتوای کاربران اختصاص دهند.

روزن میگوید: «این به ما کمک کرد زیرا حالا میتوانیم آنها را مسئول بدانیم»، او همچنین افزود که تغییرات فعلی اعتراف به آزاد بودن قوانین سابق نیست بلکه نشان میدهد که فیسبوک با تهدیدات جدید خود را وفق داده است: «اگر چند سال پیش به گروهها نگاه میکردید شاید این رفتارها وجود نداشت».

فیسبوک همانند دیگر غولهای تکنولوژی به دلیل ممنوعیت یک سری مضامین و افراد هدف انتقاد یک سری افراد از جمله ترامپ قرار گرفته است. این پلتفرم همچنین زیر ذره بین دولت بایدن هم قرار گرفته چرا که از نحوه مدیریت فیسبوک در ماههای منتهی به انتخابات ناراضی بود.

زاکربرگ در تماسی چهارشنبه گذشته گفت که کاربران فیسبوک از حزبگرایی شدید در این پلتفرم خسته شدهاند. او گفت: «مردم نمیخواهند که سیاست و جنگ تجربه آنها در خدمات ما را تحت تاثیر قرار دهد» طبق گفته او فیسبوک نیز قصد دارد برای کاهش محتوای سیاسی در صفحه رویدادهای روزانه خود اقدام کند.

زاکربرگ همچنین گفت که این شرکت تلاش میکند گروهها را به گونهای بازطراحی کند که به «رشد افراد» همانند آنچه در جوامع شاهد هستیم کمک کند. او گفت: «ما میتوانیم تغییراتی اعمال کنیم که فیسبوک تنها مکانی برای دریافت رویدادها و پست محتوا نباشد».

نوآوری فیسبوک در سال ۲۰۱۹ به محوری استراتژیک برای تغییر تمرکز مردم از صفحه رویدادها تبدیل شد و یکی از مهمترین تغییرات این پلتفرم در سالهای گذشته بود.

این استراتژی جدید بر محتوای گروهها تاکید داشت و جریان محتوایی که از گروهها در اختیار کاربران قرار میگرفت را تقویت کرد. فیسبوک با اولویت دهی به گروهها گفت که این کار به ایجاد ارتباط معنادار با ذهنیتهای مشابه کمک میکند. این تغییر از آنجایی انجام گرفت که بسیاری معتقد بودند صفحه رویدادهای فیسبوک نسبت به مداخله خارجی و دستکاری آسیب پذیر است.

گروهها که زمانی یک ویژگی زیرمجموعه بودند حالا به مرکزیت طراحی، سیستمهای پیشنهاد دهنده و قابلیتهای دوستیابی این اپلیکیشن تبدیل شدند. زاکربرگ در آن زمان در مصاحبهای با روزنامه والاستریت گفت که فیسبوک شش ماه روی این موضوع کار کرده تا تحولی مسئولانه را تضمین کند و این شرکت واقف است که نباید با الگوریتمهای خود توصیههای درمانی بی اساس و نظریههای توطئه را ترویج کند. او گفت: «اگر مردم خودشان واقعا به دنبال این محتوا باشند مشکلی نیست.»

این مفهوم به مرکزیت برند سازی فیسبوک تبدیل شد و درواقع پاسخی به انتقادات بحث حریم خصوصی و نقش کمبریج آنالتیکا در انتخابات ۲۰۱۶ بود.

نینا جانکویکز محقق شبکههای اجتماعی در مرکز تحقیقات وودرو ویلسون در واشنگتن میگوید پس از اینکه شنیدم نماینده فیسبوک به مسئول شبکه اجتماعی یک نخست وزیر اروپایی میگوید که حالا گروهها بهترین راه رسیدن به مخاطب عظیم در این پلتفرم هستند زنگ خطر برایم به صدا درآمد.

خانم جانکویکز که وجه اشتراک دموکراسی و تکنولوژی را مطالعه میکند میگوید: «چشمانم از حدقه بیرون زد. من میدانستم که گروهها تا چه اندازه میتوانند مخرب باشند».

او میگوید مشکل این بود که فیسبوک در کنار تقویت الگوریتمی گروهها، خود نظارتی بر آنها نداشت. بخش پیشنهادات تنها با چند کلیک افراد را از یک گروه سلامتی به یک گروه ضد قرنطینه و سپس به یک گروه شبه نظامی منتقل میکرد. فیسبوک نهایتا گروههای شبه نظامی را به طور کلی از این پلتفرم را حذف کرد. او میگوید: «ابزارهای فیسبوک برای تقویت رشد گروه-مثلا اجازه ارسال هزاران دعوتنامه روزانه برای دسترسی به کاربران جدید و نمایش نمایی کلی از گروه در بخش دعوتنامهها حتی پیش از اینکه فرد به گروه ملحق شود-این خطرات را پررنگتر میکرد.

او ژوئن گذشته مقالهای به نام «گروههای فیسبوک در حال نابودی آمریکا» برای مجله وایرد (Wired) نوشت و توضیح داد که انتشارات حزبی و فعالان خارجی برای انتشار نظریههای توطئه و دروغ از گروهها استفاده میکنند.

در سال ۲۰۱۶ در یک نشست درمورد تغییر تلاشهای فیسبوک برای مبارزه با قطبی شدن جامعه محققی اشاره کرد که محتوای افراطی گروههای بزرگ سیاسی آلمان را پر کرده است و «۶۴ درصد از تمامی افراد ملحق شده به دلیل ابزارهای پیشنهاد دهنده ما با این گروهها آشنا شدهاند». در این کنفرانس نتیجه گیری شد که «سیستمهای پیشنهاد دهنده ما مشکل را بزرگ تر میکنند.»

فیسبوک در پاسخ به این مقاله گفت که مشکلات بخش پیشنهادات خود را حل کرده است.

کنفرانس داخلی این شرکت در آگوست سال ۲۰۲۰ نشان داد که گروههای آمریکایی مرتبط با سازمانهای نفرگیری و حزبگرایی از ابزارهای فیسبوک برای دسترسی به مخاطبان عظیم استفاده میکنند. بسیاری از موفقترین گروهها تحت نظارت مدیرانی بودند که با نفرتپراکنی، آزار و درخواست برای خشونت مشکلی نداشتند یا آنرا تقویت میکردند و یک گروه بزرگ «تحریک آمیزترین اخبار روز را جمعآوری کرده و آنرا در اختیار مخاطبانی قرار میدهد که دائما درخواست خشونت میکنند.»

مدیران اکثر این گروهها را به گروه خصوصی تبدیل میکردند تا تنها اعضا قادر به خواندن محتوا باشند. برخی حتی سری بودند یعنی افراد خارج از فیسبوک از وجود آن اطلاعی نداشتند و با این حال میلیونها نفر در هفته از آنجا بازدید میکردند.

در این کنفرانس اشاره شد که برخی از مشهورترین گروهها را آمریکاییها اداره نمیکردند. گروهی به نام «دونالد ترامپ برای سال ۲۰۲۰، موج قرمز» احتمالا «با منشا مقدونی» میزبان بیشترین نفرت پراکنی در بین تمامی گروههای آمریکایی فیسبوک را داشت. براساس دادههایی که وبسایت حقیقتیابی اسنوپس(Snopes) پیش از حذف این گروه در ماه سپتامبر به دست آورده بود، این گروه طی دو ماه پس از آغاز به کار در تابستان سال گذشته بیش از یک میلیون کاربر به دست آورد.

روزنامه والاستریت نتوانست با مدیر این صفحات تماس برقرار کند و به درخواست ما برای اظهارنظر نیز پاسخی داده نشد. اکثر گروهها مربوط به راستیهای طیف سیاسی مربوط میشدند اما گروه «زنان خانه دار حومه شهری علیه ترامپ» نیز یکی از گروههای مهمی بود که در کنفرانس ماه آگوست به آن اشاره شد. این گروهها چه محافظه کار و چه لیبرال یک وجه مشترک داشتند: همه آنها کاربرانی پر و پا قرص داشتند و ابزارهای نفرگیری فیسبوک به رشد سریع آنها کمک میکرد.

محتوای ۱۰ گروه مدنی ۹۳ میلیون بار در طول هفت روز ار تابستان دیده شده بود. در کنفرانس آگوست اشاره شد که قانون شکنی گروههای بزرگ معمولا نادیده گرفته میشد و مدیران به کاربران خود آموزش میدادند که چطور محتوای توهین آمیز را به گونهای ارسال کنند که از فیلترهای خودکار فیسبوک عبور کند.

محققان فیسبوک درمورد مدیران صفحه «کلوپ طرفداران کایلی مکانی» که به نام مشاور خبری دولت ترامپ-اما بدون ارتباط با او-ساخته شده بود گفتند که «آنها عمدتا اتمسفری سمی ایجاد می کنند». محققان گفتند که این گروه عمدتا به عنوان سیستم توزیعی برای «محتوای خبری احتمالا ساختگی، کم کیفیتی و بسیار تفرقه افکن» عمل میکند.

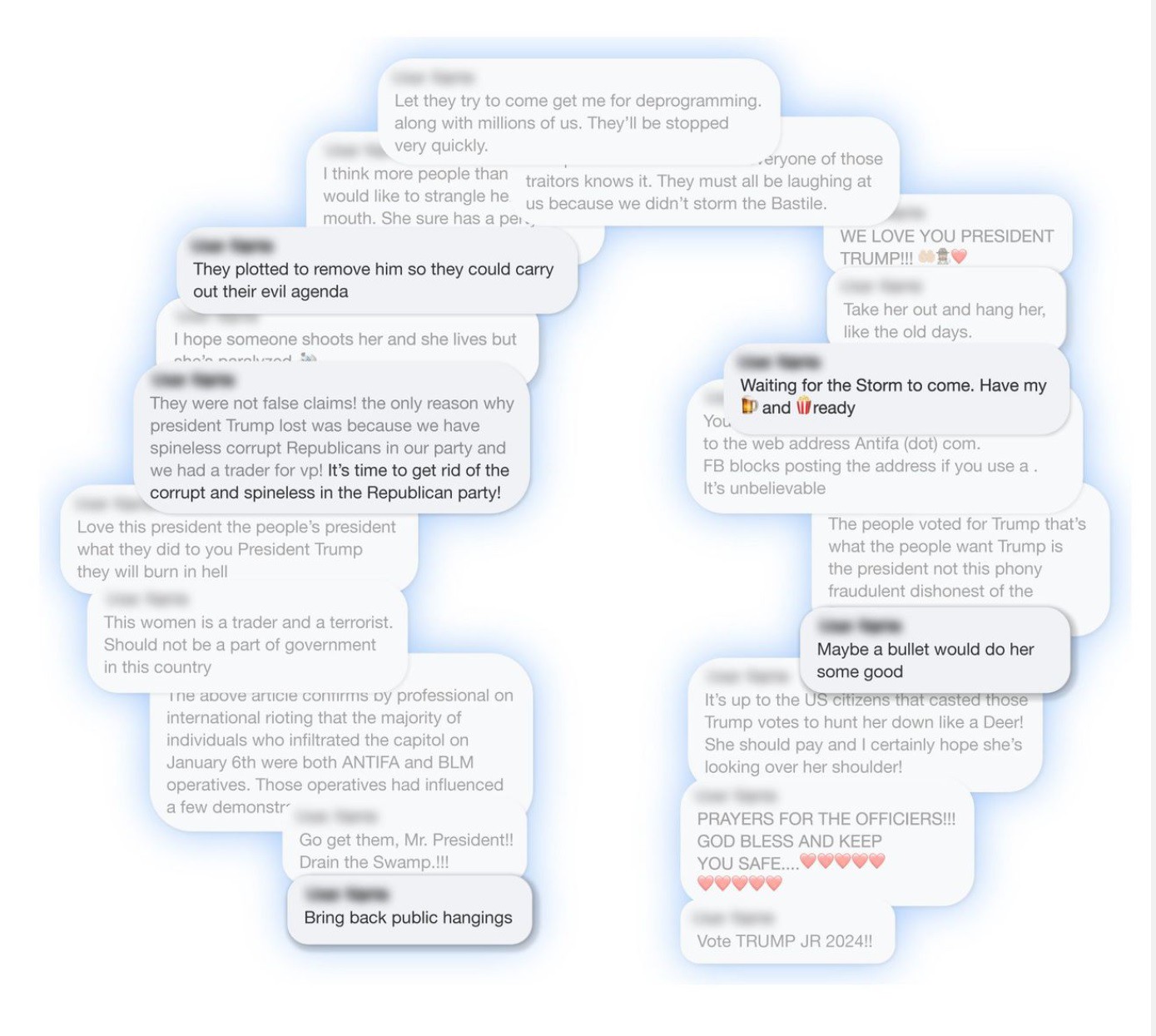

طبق گفته محققان نظرات این گروه شامل تهدید به مرگ برای فعالان نهضت جان سیاه پوستان و اعضای کنگره بود و فیسبوک ۱۷۴ بار در طول سه ماه هشدار شایعه را برای این گروه فعال کرده بود. در نظرات مربوط به یک پست راجب ایلهان اومار نماینده جمهوری خواه این جملات گفته شده بود:

«امیدوارم کسی به او شلیک کند اما زنده بماند و فلج شود»

«شاید یک گلوله برای او خوب باشد»

«اعدام در ملا عام را برگردانید»

روزنامه والاستریت با پنج مدیر این کلوپ از طریق فیسبوک تماس برقرار کرد و به مخاطبان این خروجیها نیز برای اظهار نظر پیغام داد اما پاسخی دریافت نشد.

تیم سیاست عمومی فیسبوک مانع اقدام علیه گروههای بزرگ محافظه کاران میشد و مدیران بخشهای دیگر این شرکت طرفداران محدودیتهای پیشنهادی درمورد تاثیرات رشد گروهها را زیر سوال بردند. کارکنان بخش یکپارچگی فیسبوک برای مقابله با این مقاومتها روزانه تحلیلهایی را برای آقای روزن و دیگر مجریان ارشد ارسال میکردند که نشان میداد روشهای فیسبوک برای نظارت بر گروههای بزرگ نمیتواند مشکل نقض فاحش استانداردهای اجتماعی این شرکت را رفع کند.

قوانین فیسبوک نفرت پراکنی و صحبتهایی که تحریک به خشونت کند را ممنوع میداند. این شرکت به ناظران گروهها درمورد چگونگی حفظ قوانین اجتماعی مشاوره میدهد. اما رهبران گروههای سیاسی به جای اینکه به رفع مشکل کمک کنند کاربران را به نقض قوانین ترقیب میکردند و هرکسی که چنین محتوایی را گزارش کند تهدید به اخراج میکردند یا کاربران را برای ارسال نظرات خشن و توهین آمیز در صفحه آنها هدایت میکردند.

فیسبوک از صحبت درمورد جزئیات برخورد این شرکت با یافتههای محققان خودداری کرد.

بنیاد موزیلا که مرورگر فایرفاکس را میسازد و میگوید به دنبال اینترنت سالم است در 20 اکتبر یک تبلیغ تمام صفحه در واشنگتن پست منتشر کرد و از فیسبوک خواست سیستم پیشنهادات الگوریتمی خود برای گروهها متوقف کند. در این نامه گفته شده بود که «متخصصان بسیاری-و حتی برخی از کارکنان خودتان-نشان دادهاند که این ویژگیها انتشار شایعات را تقویت میکند» و در آن از جک دورسی مدیرعامل توییتر هم خواسته شده بود که قابلیت موضوعات ترند الگوریتمی را نیز غیرفعال کند.

توییتر این قابلیت را غیرفعال نکرد اما جزئیات آن را افزایش داد و به صورت دستی یک سری ترندهای تحریک آمیز مثل «اعدام مایک پنس» را حذف کرد. یکی از سخنگویان توییتر گفت که این شرکت سریعا برای حذف درخواست اعدام مایک پنس اقدام کرد و جزئیات بیشتری را به قابلیت ترند خود اضافه کرد.

اشلی بوید نماینده ارشد موزیلا در زمینه مشاوره و مشارکت میگوید که این بنیاد پیش از انتشار این نامه نگرانیهای خود را با کارکنان سیاست اجتماعی فیسبوک درمیان گذاشته است. او گفت: «آنها نگفتند که ما دیوانه هستیم. گفتند که آنچه میگویید خیلی شبیه به صحبتهایی است که ما در داخل شرکت میکنیم.»

به گفته سخنگوی فیسبوک حتی پیش از اینکه موزیلا نامه خود را منتشر کند هم فیسبوک پیشنهادات الگوریتمی خود برای گروههای سیاسی یا موضوعات مدنی را به طور موقت متوقف کرده بود.

فیسبوک پیش نمایش محتوای گروه برای اعضای جدید احتمالی را متوقف کرد و تعداد دعوتنامههای ارسالی در هرروز را محدود کرد و هرگاه فیلترهای خودکار این شرکت به دلیل نفرت پراکنی و خشونت در یک رشته نظر فعال میشدند این شرکت آن رشته نظرات را متوقف میکرد. روزن این اقدامات پیش از انتخابات را تایید کرد.

قوانین جدیدی که فیسبوک طراحی کرد قرار بود موقت باشند و بیشتر آنها اعلام عمومی نشدند و البته این قوانین نتوانست از رشد سریع برخی گروهها پس از انتخابات جلوگیری کند. گروهی به نام «دزدی را متوقف کنید» یکی از مهمترین موردهایی بود که اعتراضات پس از انتخابات را رهبری میکرد و در کمتر از ۲۴ ساعت بدون استفاده از الگوریتمهای فیسبوک به ۳۶۱ هزار عضو رسید. فیسبوک پس از حذف این گروه در ۵ نوامبر گفت که این گروه «در حال ساماندهی مشروعیت زدایی از فرایند انتخابات بود و ما نگرانی درخواست برای خشونت از سوی برخی از اعضای این گروه بودیم.»

براساس مستندات داخلی و گفتههای افراد مطلع، آقای زاکربرگ به دلیل ترس از از خونریزیهای سیاسی آنروز یک اقدام اضطراری را تایید کرد که شامل محدودیت روی گروههایی با سابقه بد رفتاری میشد.

براساس این مستندات پس ازاینکه چند روز پس از این اقدام شاهد خشونتی درزمینه شمارش آرا نبودیم فیسبوک برخی از محدودیتهای خود را کاهش داد. این اقدام به کارکنان و خبرنگاران یادآور شد که این اقدامات همواره موقتی هستند.

در روز ۶ ژانویه پس از جریانی که توسط ایمی و کایلی کرمر-مادر و دختری که گروه اصلی «دزدی را متوقف کنید» را ساخته بودند- سازماندهی شده بود گروهی از طرفداران ترامپ به پایتخت حمله کردند. خانواده کرمر به درخواست ما برای اظهارنظر پاسخ ندادند. فیسبوک پس از ناآرامیها گروههای دیگری که از «دزدی را متوقف کنید» در نام خود استفاده میکردند را نیز حذف کرد.

مستندات داخلی نشان میدهد که فیسبوک با تایید زاکربرگ در اقداماتی اضطراری ابتدا محدودیتهای اضافی روی گروهها اعمال کرده و سپس آنها را متوقف کرد. او در یک پست وبلاگی ترامپ سرزنش کرد و گفت که او میخواسته از فیسبوک برای «ترویج خشونت» استفاده کند. فیسبوک الزام کرد که در گروههایی با سابقه نقض قوانین، پستهای بیشتری به تایید مدیران نیاز داشته باشد.

شریل سندبرگ مدیر اجرایی ارشد فیسبوک مسئولیت ساماندهی ناآرامیها را به گردن پلتفرمهای اجتماعی کوچکتر انداخت در حالیکه فیسبوک در همان زمان میزبان گروهها بود. این شرکت ۴۰ مورد از ۱۰۰ گروه برتری که در کنفرانس ماه آگوست لیست شده بود را از پلتفرم خود حذف کرد. سندبرگ از اظهارنظر در این باره خودداری کرد.

فیسبوک علاوه بر حذف پیشنهادات الگوریتمی برای گروههای مدنی و درمانی از هرگونه تبلیغی برای این گروهها در ۲۱ روز اولیه جلوگیری میکند. دیگر اقدامات موقت ز جمله بستن رشته نظراتی و محدودیت دعوتنامه برای گروهها نیز به سیاست دائمی تبدیل میشوند.

به گفته افراد مطلع، فیسبوک سال گذشته پس از صحبت هیئتهای داخلی خود درمورد نقش این پلتفرم در انتخابات ریاست جمهوری آمریکا صحبتهای سیاسی را محدود کرد و نظارت بر آن را به ناظران حرفهای سپرد.

روزن میگوید: «رشد سریع به خودی خود نشان دهنده خوب یا بد بودن نیست». اما زمانی که پای مدیریت خطر برای محصولات فیسبوک درمیان باشد «تعادل همیشه بهتر است».

منبع: WSJ