شبیهسازی اجتماعی LLMها و آزمایش سیاستها روی جامعه مصنوعی

اگر روزی هزاران هوش مصنوعی بتوانند مثل انسانها کار کنند، دوست پیدا کنند، خرید کنند،…

۱۱ خرداد ۱۴۰۵

۱۵ آذر ۱۴۰۴

زمان مطالعه : ۶ دقیقه

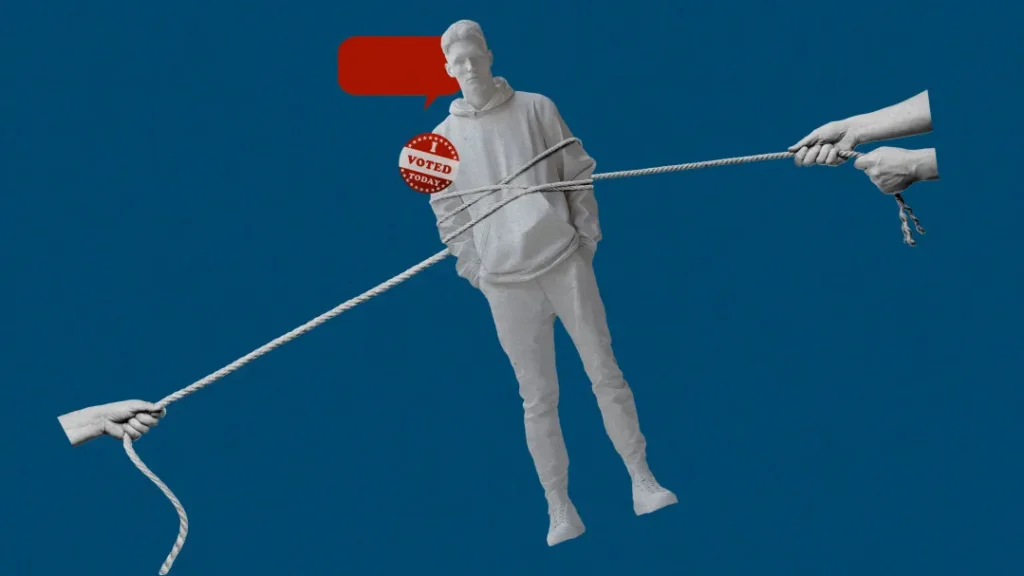

دو پژوهش مهم که همزمان در مجلات Nature و Science منتشر شده، تصویری را ترسیم میکنند که شاید نشان دهنده نقش نگرانکننده فناوری هوش مصنوعی در آینده انتخابات سیاسی باشد. این مطالعات نشان میدهند گفتوگو با یک چتبات هوش مصنوعی میتواند تنها در چند دقیقه دیدگاه و نظر رایدهندگان را نسبت به نامزدهای انتخاباتی تغییر دهد؛ تغییری که در برخی موارد چند برابر بیشتر از تاثیر تبلیغات رایج سیاسی گزارش شده است. اما نکته مهمتر آنکه هرچه این چتباتها در متقاعد کردن مخاطب موفقیت بیشتری داشته باشند، احتمال ارائه اطلاعات نادرست در پاسخهایشان نیز بیشتر میشود.

به گزارش پیوست، نشریه MIT در مقالهای با اشاره به این دو مطالعه میگوید گرچه پیش از این هم استفاده از چتباتها در انتخابات گزارش شده است و شماین دنیلز، نامزد دموکرات کنگره در پنسیلوانیا، از چتباتی به نام «اَشلی» برای برقراری تماس با رأیدهندگان استفاده کرده اما یافتههای جدید این دو مطالعه تصویر نگرانکنندهای را ترسیم میکند که شاید آینده انتخابات و رویه دموکراتیک را در معرض خطر جدی قرار دهد. از این رو پژوهشگران به قانونگذاری شفاف در این حوزه و نظارت بیشتری توصیه کردهاند.

با اینکه تماسهای اشلی نتوانست به پیروزی دنیلز منجر شود، اما پژوهشگران اکنون دریافتهاند چنین مکالماتی میتوانند رفتار سیاسی افراد را به شکل قابلتوجهی تحت تاثیر قرار دهند.

برای بررسی این مساله تیمی از دانشگاههای مختلف آمریکا و اروپا در مطالعهای که در مجله Nature منتشر شده است، بیش از ۲۳۰۰ نفر را وارد مکالمه با یک چتبات کردند؛ مدلی که به صورت ویژه برای حمایت از یکی از دو نامزد انتخابات ریاستجمهوری آمریکا طراحی شده بود.

این مطالعه در نهایت نشان داد حمایت رایدهندگان از نامزد مقابل، براساس مقیاس ۱۰۰ امتیازی افزایش یافته است. این تاثیر چند برابر آن چیزی است که پیش از این طی تحقیقات سالهای ۲۰۱۶ و ۲۰۲۰ درمورد اثر تبلیغات سیاسی گزارش شده است.

براساس این مطالعه کاربران آمریکایی حامی دونالد ترامپ پس از مکالمه با چتبات طرفدار کامالا هریس، نزدیک به چهار واحد به سمت او تغییر نظر دادند. همینطور در جهت مخالف، رایدهندگان حامی هریس پس از گفتوگو با یک چتبات طرفدار ترامپ بیش از دو واحد تغییر نظر دادند. این آزمایشها در کانادا و لهستان نیز تکرار شد و نتایج در این دو کشور چشمگیرتر از آمریکا بود و در برخی موارد میزان تغییر نگرش به ده واحد هم رسید.

این مطالعه نشان داد که برخلاف تصوری دیرینه علوم سیاسی که براساس آن رایدهندگان اطلاعات مخالف باورهایشان را نادیده میگیرند، چتباتها زمانی بیشترین تاثیر را دارند که استدلالهای خود را با «حقایق» و «شواهد» پشتیبانی میکنند.

اما یکی از مشکلات مهم در همین بخش پدیدار میشود و آن اینکه بسیاری از «حقایقی» که چتباتها با اعتماد کامل برای اقناع افراد ارائه میدادند، نادرست بودند. پژوهشگران دریافتند مدلهای هوش مصنوعی، بهخصوص زمانی که برای حمایت از نامزدهای راستگرا تنظیم میشوند، ادعاهای غلط بیشتری را در اختیار کاربر قرار میدهند تا نظر او را تغییر دهند. این موضوع احتمالا ناشی از دادههای آموزشی این مدلهاست که دربرگیرنده حجم عظیمی از محتوای آنلاین، شامل خطاهای انسانی و قطبیسازی سیاسی، است.

در مطالعه دوم که در Science منتشر شده است، پژوهشگران ۱۹ مدل مختلف زبان هوش مصنوعی را با ۷۷ هزار شرکتکننده بریتانیایی مورد بررسی قرار دادند. پژوهشگران متغیرهای مختلفی را، از قدرت محاسباتی گرفته تا تکنیکهای آموزش، تغییر دادند تا دریابند چه چیزی موجب میشود این مدلها در قانع کردن مخاطب عملکرد بهتری داشته باشند.

این مطالعه نشان داد که وقتی مدلها با نمونههایی از مکالمات «بسیار قانعکننده» آموزش داده میشوند و هنگام گفتگو نیز به استفاده فراوان از شواهد و اطلاعات موظف میشوند، توانایی آنها در تغییر نظر افراد به شکل چشمگیری افزایش مییابد. در برخی موارد، چتباتها توانستند تا نظر افرادی که کاملا مخالف یک موضع سیاسی بودند را تا ۲۶ واحد تغییر دهند. این میزان اثرگذاری در علوم سیاسی تقریبا بیسابقه است.

اما درست همان الگویی که در مطالعه نخست دیده میشد، در این مطالعه نیز تکرار شد. چتباتی که بیشترین قدرت را در متقاعد کردن کاربران داشتند، همان مدلی بود که بیشترین حجم اطلاعات نادرست را نیز تولید میکرد.

پژوهشگران هنوز مطمئن نیستند چرا چنین ارتباطی میان این دو موضوع وجود دارد، اما حدس میزنند که هرچه مدلها تلاش بیشتری برای تولید «تعداد بالایی از شواهد» کنند، بیشتر به یافتههای کمکیفیت یا نادرست موجود در دادههای آموزشیشان متوسل میشوند. این موضوع نشان میدهد تقویت قابلیتهای اقناعی هوش مصنوعی، بدون نظارت مناسب، میتواند به افزایش گسترده اطلاعات غلط منجر شود.

این یافتهها ممکن است پیامدهای مهمی در انتخاباتهای آینده داشته باشند. چتباتهایی که قابلیت گفتوگو و متقاعد کردن افراد را دارند شاید در آینده نقش مهمی در کارزارهای انتخاباتی ایفا کنند و چه به صورت رسمی توسط ستادهای انتخاباتی و چه به صورت غیررسمی مورد استفاده قرار گیرند.

این مدلها به سادگی میتوانند حجم عظیمی از گفتگوهای فردی را اداره کنند و در واقع یکی از محدودیتهای مهم کارزارهای سیاسی را برطرف کنند، زیرا مکالمه انسانی میتواند وقتگیر و پرهزینه باشد. در چنین شرایطی، کارزارهایی که به مدلهای پیشرفتهتر دسترسی دارند قادرند تا آرای مرددها یا حتی بخشی از پایگاه رایدهندگان حریف سیاسی خود را هدف گرفته و نظر آنها را تغییر دهند.

از سوی دیگر، روشن نیست آیا همه گروههای سیاسی به مدلهایی با کیفیت یکسان دسترسی خواهند داشت یا خیر. اگر یک جناح یا نامزد بتواند از مدلهای بسیار پیشرفتهتر استفاده کند، یا اگر رایدهندگان یک جناح نسبت به جناح دیگر علاقه بیشتری به تعامل با چتباتها داشته باشند، توازن رقابت انتخاباتی شاید بهطور جدی برهم بخورد.

یکی از احتمالات دیگر هم این است که مردم بدون دخالت ستادهای انتخاباتی، خودشان برای تصمیمگیری سیاسی از چتباتها کمک بگیرند. این موضوع میتواند انتخابهای فردی را، حتی زمانی که کاربران تصور میکنند مستقل عمل کرده، تحت تاثیر قرار دهد.

از این رو پژوهشگران هشدار میدهند که برای جلوگیری از این خطرات به مقرراتی روشن در این حوزه نیاز است و ابزارهای قدرتمندی باید برای ارزیابی و مستندسازی دقت مدلها ایجاد شود و در غیر این صورت هوش مصنوعی میتواند اعتماد عمومی به روند انتخابات و حتی ماهیت تصمیمگیری دموکراتیک را در معرض خطر قرار دهد.

به گفته پژوهشگران، نخستین قدم باید ایجاد سازوکاری شفاف برای ممیزی عملکرد چتباتها در بحثهای سیاسی باشد؛ سازوکاری که بررسی صحت اطلاعاتی را نیز شامل میشود. به گفته آنها اگر قرار بر این باشد که این ابزارها نقشی در اطلاعرسانی سیاسی ایفا کنند، باید در نقش «نگهبانان حقیقت» باشند و در کنار مردم قرار بگیرند.