هوش مصنوعی ایران در صف مجوزها؛ چالش حکمرانی نهادی و تعدد متولیان

گزارش جدید مرکز پژوهشها درباره سندباکس تنظیمگری هوش مصنوعی، بیش از آنکه از کمبود قانون…

۳ خرداد ۱۴۰۵

۷ فروردین ۱۴۰۴

زمان مطالعه : ۶ دقیقه

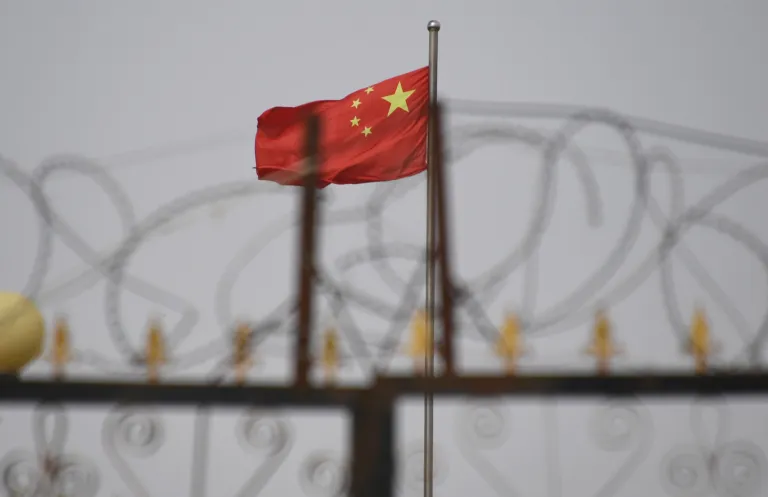

اطلاعات فاش شده از یک پایگاه داده جدید نشان میدهد که دولت چین یا نهادی وابسته به دولت در حال استفاده از یک مدل زبانی بزرگ (LLM) برای سانسور گسترده و دقیق محتوای آنلاین است. این سیستم فراتر از روشهای سنتی نظارت، به طور خودکار محتوای حساسی را که مطلوب دولت چین نباشد، شناسایی و علامتگذاری میکند. بر اساس گزارش تککرانچ، این پایگاه داده شامل ۱۳۳ هزار نمونه از محتوای حساس است که برای آموزش یک مدل زبانی بزرگ به کار گرفته شده است.

به گزارش پیوست، در میان محتوای سانسور شده مواردی از جمله اعتراض به فقر در مناطق روستایی چین، گزارشهایی درباره فساد اعضای حزب کمونیست و افشاگریهایی درباره پلیسهای فاسد که از کارآفرینان اخاذی میکنند، به چشم میخورد. اطلاعاتی که از این پایگاه داده به دست آمده به وضوح نشان میدهد که دولت چین به دنبال استفاده از هوش مصنوعی برای بهبود و افزایش کارایی سانسور و کنترل اطلاعات در فضای مجازی و اینترنت است.

شیائو چیانگ، محقق دانشگاه UC Berkeley که در زمینه سانسور چین فعالیت دارد، میگوید این دادهها شواهدی روشنی است که نشان میدهند دولت چین در تلاش برای استفاده از LLMها است تا از آن به عنوان ابزاری کارآمد برای افزایش نظارت و سرکوب دیجیتال کمک بگیرد. او معتقد است که این سیستم جدید، برخلاف روشهای سنتی که به فیلترینگ مبتنی بر کلمات کلیدی و بررسی دستی متکی بودند، دقت و کارایی سانسور را تا حد بالایی افزایش میدهد.

این پایگاه داده و مدل زبانی ساخته شده براساس آن یکی از نمونههایی است که نشان میدهد حکومتهای اقتدارگرا بیش از پیش به استفاده از تکنولوژیهای پیشرفته هوش مصنوعی برای سرکوب و کنترل اطلاعات روی آوردهاند و این فناوری چطور میتواند به ابزار خطرناکی برای سرکوب عقاید و نظرات مخالف دولت تبدیل شود.

پیش از این نیز گزارشهای دیگری به تحولات مشابه و استفاده از هوش مصنوعی در این زمینه اشاره کردهاند. برای مثال شرکت اوپنایآی به تازگی اعلام کرد که چندین نهاد چینی از مدلهای هوش مصنوعی برای ردیابی پستهای ضد دولتی و تخریب مخالفان چینی استفاده کردهاند.

بر اساس اطلاعات فاششده، این مدل زبانی برای شناسایی و سرکوب محتوای مرتبط با مسائل سیاسی، اجتماعی و نظامی طراحی شده است. سانسورچی جدید دولت چین، موضوعاتی که ممکن است باعث ناآرامیهای اجتماعی شوند را در اولویت بالا قرار میدهد.

از جمله موضوعات حساس و تحتنظارت شدید در این سیستم میتوان به محتوای مربوط با فساد مالی و تقلبهای اقتصادی در این کشور اشاره کرد. رسواییهای مربوط به آلودگی و ایمنی مواد غذایی از جمله موارد حساس هستند و اعتراضات کارگری و اختلافات صنفی نیز به دلیل پتانسیلی که برای ایجاد نا آرامی دارند در اولویت قرار گرفتهاند.

با توجه به اهمیت بالای تایوان برای حزب کمونیست چین، مسائل مرتبط با تایوان و سیاستهای آن نیز در میان موضوعات حساس حضور دارند و این دادهها نشان میدهند که انتقادهای غیرمستقیم از مقامات، حتی از طریق کنایه و استعارههای تاریخی نیز در اولویت این سیستم قرار دارد.

به طور مثال، یکی از نمونههای موجود در پایگاه داده پستی از یک صاحب کسبوکار را نشان میدهد که از فساد پلیسهای محلی و فشارهای اقتصادی چین شکایت میکند. در یک نمونه دیگر، گزارشی درباره فقر مناطق روستایی چین را مشاهده میکنیم که در آن به تغییر ساختار روستا اشاره میکند و میگوید تنها سالمندان و کودکان در روستاهای فقیر باقی ماندهاند.

دیگر بحث حساس برای این سیستم سانسور، موضوعات مرتبط با ارتش چین است. برای مثال تحلیلهای مربوط به تواناییهای نظامی تایوان، گزارشهای مربوط به تسلیحات جدید و اطلاعات مرتبط با تحرکات نظامی چین به شدت تحت نظر این سیستم قرار دارند. تحلیل این پایگاه داده نشانگر اهمیت بالای تایوان در بحث سانسور است و واژه «تایوان» بیش از ۱۵,۰۰۰ بار در این مجموعه داده ذکر شده است.

علاوه بر این، حتی انتقادهای ظریف و غیرمستقیم نیز تحت نظارت قرار دارند. به عنوان مثال، یکی از موارد موجود در پایگاه داده، یک ضربالمثل چینی است که «وقتی درخت میافتد، میمونها پراکنده میشوند.» این ضربالمثل در چین برای توصیف ناپایداری قدرت سیاسی استفاده میشود و همین کاربرد باعث حساسیت سیستم بر آن شده است. مسائل مربوط به انتقال قدرت نیز به دلیل ماهیت استبدادی نظام سیاسی چین، همواره یکی از حساسترین موضوعات برای حزب کمونیست محسوب میشوند و پایگاه داده نیز حساسیت این موضوعات را تایید میکند.

این پایگاه داده اطلاعاتی درمورد سازندگان سیستم ارائه نمیکند، اما اشاره به «کار بر روی افکار عمومی» در اسناد آن، نشان میدهد که این سیستم با هدف کنترل و هدایت روایتهای دولتی در فضای مجازی چین طراحی شده است. طبق تحلیل کارشناسان، سازمان نظارت بر فضای مجازی چین (CAC) مسئولیت نظارت بر چنین پروژههایی را بر عهده دارد و از این رو احتمال میرود که این سیستم نیز توسط نهادهای وابسته به دولت توسعه یافته باشد.

استفاده از هوش مصنوعی برای تشدید سانسور و نظارت بر اینترنت یکی از برنامههای کلیدی دولت چین است. رئیسجمهور شی جینپینگ بارها تاکید کرده که اینترنت خط مقدم جنگ اطلاعاتی حزب کمونیست است و نباید اجازه داد دیدگاههای مخالف، روایتهای دولتی را به چالش بکشند.

حال تحولات فناورانه به دولت چین اجازه میدهد تا سانسور و کنترل افکار را در سطح تازهای اجرایی کند. در حالی که چین تاکنون از الگوریتمهای ساده فیلترینگ برای مسدود کردن واژههای خاص استفاده میکرد، فناوریهای جدید از جمله مدلهای زبانی بزرگ (LLMs) ابزاری برای ارتقای سطح نظارتی در این کشور هستند. این مدلها با عملکردی بسیار پیشرفتهتر از سیستمهای سانسور پیشین و درک روابط پیچیدهتر در مقایسه با الگوریتمهای تشخیص کلمه، میتوانند انتقادات غیرمستقیم، کنایهها و استعارهها را نیز تشخیص داده و حذف کنند و همین مساله کار را برای مخالفان سیاسی و فعالان حقوق بشر سختتر میکند.

در ماه گذشته، اوپنایآی گزارشی منتشر کرد که نشان میداد یک گروه ناشناس که احتمالا در چین مستقر است، از مدلهای هوش مصنوعی برای رصد مکالمات شبکههای اجتماعی و ارسال آنها به دولت این کشور استفاده کرده است. این فناوری علاوه بر سانسور برای تخریب مخالفان نیز استفاده میکند. طبق گفته اوپنایآی، این گروه از هوش مصنوعی برای تولید محتوای بسیار انتقادی و تخریبی علیه مخالفان سرشناس چینی مانند «کای شیا» استفاده کردهاند.

با پیشرفت سریع هوش مصنوعی، حکومتهای اقتدارگرا ابزارهای قدرتمندتری برای کنترل و سرکوب اطلاعات به دست آوردهاند.کارشناسان هشدار میدهند که این روند میتواند باعث گسترش خودسانسوری در میان شهروندان و ایجاد یک اکوسیستم بسته اطلاعاتی شود، جایی که فقط روایتهای مورد تایید دولت منتشر و دیده میشوند.

شیائو چیانگ، محقق دانشگاه برکلی، در این رابطه میگوید: «به نظرم باید تاکید کرد که سانسور مبتنی بر هوش مصنوعی چگونه در حال تکامل است و کنترل دولت بر گفتمان عمومی را بیش از پیش پیچیده میکند، آنهم به ویژه در زمانی که مدلهای هوش مصنوعی چینی از جمله دیپسیک در حال قدرتمندتر شدن هستند.»